Что нужно знать об истории, в которой нейросеть украла голос актрисы озвучания... для порно

Не то, чтобы мы яростно поддерживали какую-либо из сторон, просто уж очень интересный прецедент. И если вы думали, что интернет-технологиям с вас нечем поживиться, то вы ошибались.

Итак, для тех, кто нифига не понял и хочет сразу вникнуть суть, оригинальное видео:

Думали, что нейросетки украдут у вас работу? Вы явно недооценили их, они украдут вашу личность. И мы сейчас не о шизотеориях с восстанием машин, а о конкретных случаях, которые уже происходят. Всё не так пафосно как в фильмах ужасах, но тоже неприятно и проблематично.

Ну, так-то роботы ещё не протестуют против создателей. Но нейросети уже сделали художников истинными творцами (то есть голодными), как вы знаете. Все уже попробовали сгенерировать свои «графические шедевры» в телеграм-ботах и приложениях? Теперь очередь дошла и до аудио сферы. На этот раз пострадали бойцы невидимого фронта — актёры озвучания.

Особенности озвучки

Как мы вообще представляем себе работу этих актёров? Существует конкретный заказ, актёр выбирает сам, в каких проектах он будет участвовать, понимает, где будет звучать его голос и в каких целях, подписывая контракт. Все осознают, во что вписываются, вернее осознавали. Такой расклад был актуален до недавнего времени. Теперь правила игры меняются и не в пользу исполнителей заказов.

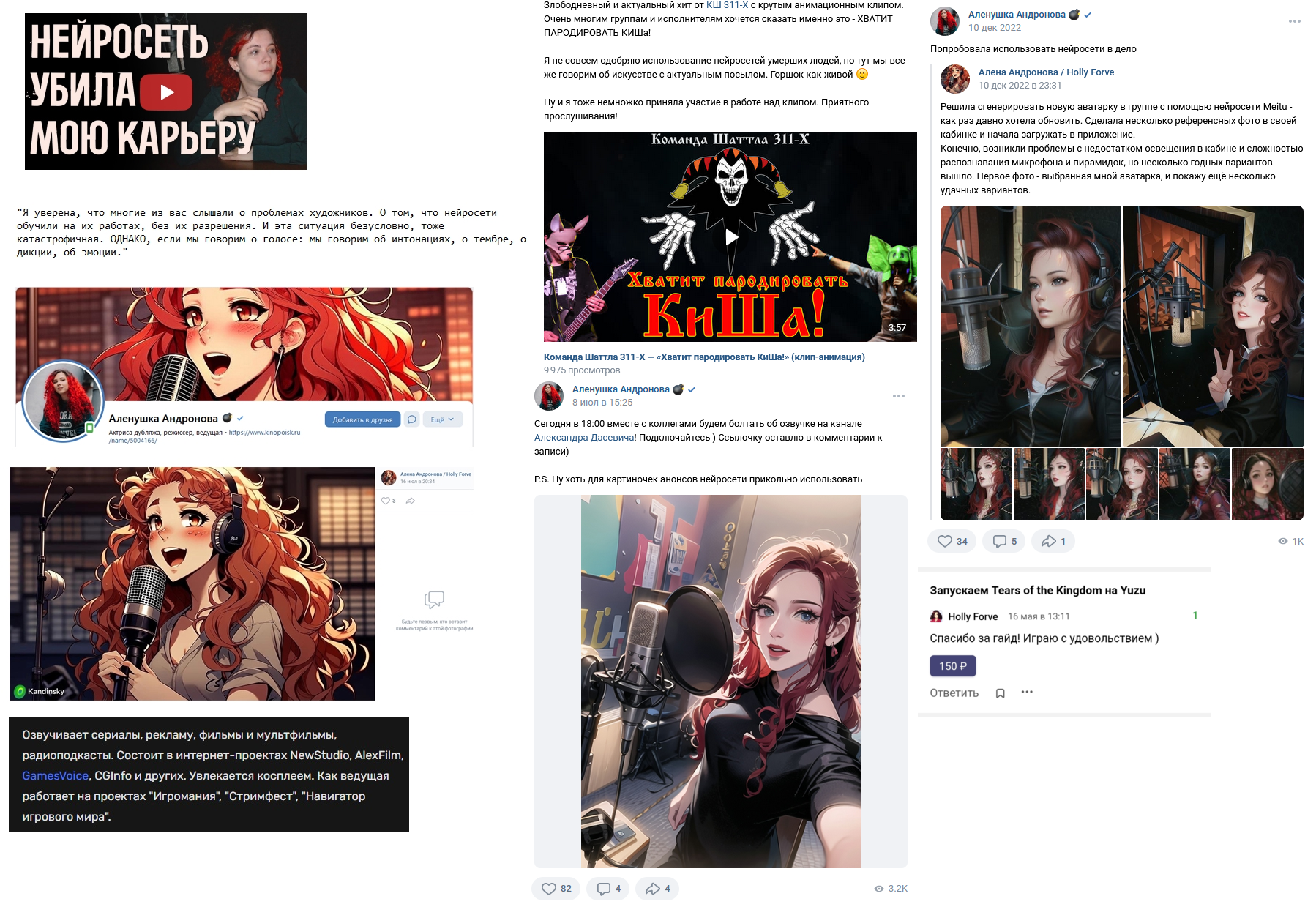

Своей историей поделилась актриса озвучания Алёна Андронова. Она несколько лет назад поработала с банком Тинькофф, а потом выяснилось, что её голос используют для рекламных предложений на сайтах 18+. И это очень неприятная ситуация, когда без вашего ведома используется ваш же голос, который ни с чьим не спутать. А ещё хуже, когда твой голос — главный рабочий инструмент, поэтому из-за того, что он мелькает на сомнительных сайтах, есть риск новую работу больше и не получить.

Для тех, кто ещё в танке: современные технологии шагнули так далеко, что теперь любой голос можно скопировать и дальше озвучивать им что угодно. Наподобие озвучки от гугл-переводчика, только качественнее и почти неотличимо от обычной речи. Эдакий «дипфейк» в аудио формате.

Как же так случилось и при чём тут банк?

В далёком 2019 Алёна выполняла конкретный заказ для Тинькофф, а именно озвучка их нейросетки. Со слов девушки договор был расплывчатым, а её заверили, что материал будет использоваться конкретно для нужд банка и не для сторонних ресурсов. И так бы оно и было, если бы Тинькофф не выкатили свой синтез речи Tinkoff VoiceKit, с помощью которого пользователи сами могут создавать автоматическую озвучку нужного текста (голосом Алёны в том числе) и распознавать речь. А дальше пошло-поехало — голос актрисы стал доноситься откуда угодно абсолютно без её ведома.

Закон и прогресс

Юридически вы не имеете права на свой голос. Чудеса-чудесные! То есть с одной стороны, ваш голос — это уникальная штука со своим тембром, интонациями, особенностями и является биометрическими данными, но на законодательном уровне вы не можете никак обложить свой голос авторскими правами. Конкретный продукт, а именно аудиодорожку, можете, а голос — нет. Вечная классика — законодательные органы попросту не успевают за техническим прогрессом.

Плюсы и минусы

С точки зрения развития прогресса и упрощения всего это супер удобно! Само собой, это очень сильно удешевляет и ускоряет работу озвучки. Отбросим все сантименты и морализаторство, просто представьте ситуацию со стороны бизнесмена. Вы создаёте какой-то проект, где требуется озвучка, у вас есть возможность использовать услуги, которые значительно дешевле и проще, ну и кто от такого откажется? Если вы принципиально готовы переплачивать за живых актёров озвучания, даже если качество будет не заметно, то, извините, но вы плохой предприниматель и далеко с такими расточительством не уедете.

Теперь другая сторона медали, вы — актёр дубляжа, ваш голос и умение им управлять буквально ваш талант, который кормит. У вас этот голос отбирают и используют как вздумается, а вы ничего не можете с этим сделать — по закону у вас нет защиты. Можно возразить, что это как Промышленная революция в 19-ом веке, или учите новые навыки, либо или не вписывайтесь в рынок, ваши проблемы. Только не забывайте, циники-капиталисты, что тут уже переплетается не только вопрос — украли или не украли работу — но ещё и личные границы. Ну не хочется всем обнаруживать свой голос в самых непонятных местах и непонятно что озвучивающий, а потом ещё и оправдываться перед знакомыми!

Не подумайте, что для синтеза речи нужны разнообразные профессиональные дикторские записи. Технологии действительно побеждают в этой гонке всухую. Сейчас достаточно нескольких предложений. Поэтому сегодня можно найти так много каверов на YouTube от исполнителей, которые никогда такого не исполняли. Если в интернете есть запись вашего голоса — его можно синтезировать, ~~вопрос только а нужен ли кому то именно ваш голос?~~

Этика в борьбе с наукой

Мы снова сталкиваемся с этой вечной дилеммой: моральная сторона или развитие прогресса. С помощью нейросетей можно реконструировать голос и речь умерших людей, даже не спросив разрешения у их родственников. Не все будут в восторге от такой эксплуатации. А если ещё и использовать голоса ныне не живущих людей в коммерческих целях?

Рассуждая о морали, стоит не забывать, что мы все любим прогресс, пока он не потрогает лично нас. Если вы не художник, не диктор и вообще нейросеть ещё не добралась до вашего ремесла, то прогресс — благо. Не чувствуйте за это угрызений совести, такова человеческая природа. Студенты хотят, чтобы чат-GPT написал за них диплом, но не хотят, чтобы он же отнял у них работу.

Любопытные пользователи обнаружили, что и Алёна Андронова, пострадавшая от синтезирования её голоса, сама не прочь использовать блага прогресса и все плюшки нейросетей, а именно не пренебрегает созданием артов. Ничего такого, но кого-то возмущает такая избирательность и рушит весь образ борца с несправедливостью.

Что делать?

Есть ощущение, что борьба с нейросетями похожа на борьбу с ветряными мельницами. Искоренить это всё равно не получится. Можно попросить официальные организации, такие как банки, не вести себя плохо и пригрозить им пальчиком — обложить штрафами и попытаться узаконить подобные процессы, только вот нейросети существуют не только в среде официальных юридических лиц. Различные телеграм-боты не дремлют, а там и функциональность пошире и выбор голосов побольше.

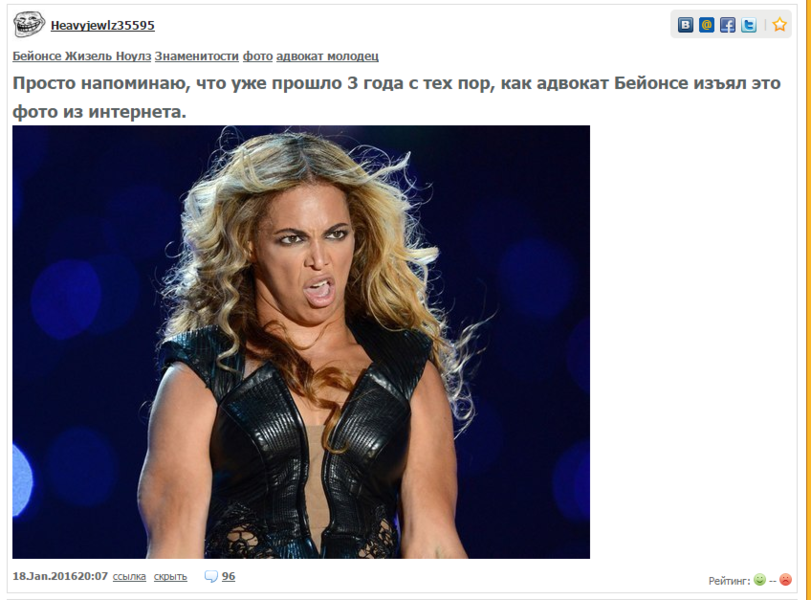

Озвучку активно используют для рекламы многих запрещённых штук, которые и так вне закона, и этим ребятам претензии за неправомерное использование голоса покажутся уж очень смешными. А попытки удалить что-то из интернета по распоряжению суда — ещё один старый анекдот (Бейонсе подтвердит). Возможно, со временем наше отношение к этому просто изменится. Человеческая культура всегда подстраивалась под изменяющиеся реалии. Услышав свой голос или голос знакомого в какой-то рекламе, мы уже будем понимать, откуда ноги растут, не придавая этому большого значения.

Пока пустить это всё на самотёк тоже не вариант — всё-таки мы пока не настолько преисполнились, чтобы забить на подобные инциденты. Законодательная база не поспевает как и в России, так и в других странах. Алёна и Союз дикторов России предложили подписать петицию (мощнейшие аргументы подъехали, Change.org всех победит), где они просят внести корректировки в российские законы, чтобы хоть как-то защититься и иметь право на свой голос.

Институт репутации, кстати, тоже никто не отменял. Одно дело — синтез голоса без разрешения непонятно от кого, там и так у людей нет репутации, но когда подобное происходит из-за подачи целого банка, лояльность к нему может измениться, особенно после огласки (хотя после всего, что сказал Олег Тиньков, банк с его именем выглядит непотопляемым и по сей день). Иногда культура отмены работает и в позитивном ключе, но это если верить в институт репутации в России.

И в завершении процитируем комментатора с ютуба: «Светлая память всем жертвам прогресса».

P.S. тут ещё хороший разбор ситуации от Сергея Сафонова (Pro-Hitech) подъехал. Наливайте чаёк, советуем ознакомиться: